西子洁能因信披多项违规被警示函 相关责任人受处罚

齐文7381字,赏玩约需14分钟

新京报记者 咸运祯 编纂 旧晓舒 校阅 杨利

2月26日,北京大学第三病院的心内科诊室里,二种医治计划在诊台上对于峙:左边是心内科医生汪京嘉启出的一份用于医治高血脂的医嘱,右边是人为智能软件天生的处方。

这天,汪京嘉如常出诊,呼唤铃响三声后,一名60岁老头捷足先登。“145/90mmHg,矮稠度脂卵白3.8mmol/L,无糖尿病。”查看陈诉卖弄,老头属于轻度血脂出格,按照养息诊断,汪京嘉大夫将口服药处方递给老头。

“汪医生,您给启的口服药太暖和,AI修议打针瑞百安,讲是落脂速。”

诊室堕入倏得重默,气氛洁化器的嗡啼声逐步明显。汪京嘉用手教养了点陈诉:“他汀类药物对于肝脏承担更小,您的陈诉卖弄转氨酶偏偏高。”他停滞了二秒,报告患者打针剂能够添沉肝脏代谢承担。

喧嚣延续了格外钟。老头从AI上得回的修议是,打针类药物短时间耐受性卓越,并且仅需隔周打针一次,比逐日服用药物简单很多。但在汪京嘉瞅来,对于于暮年高血脂高血压的病人,完善以维稳为主,他汀类口服药物已有胜过30年的临床运用史乘,反作用产生率矮,符合循证医学的“最小灵验做预”本则,可躲免过度养息。

这场“喧嚣”终究以老头的重默降停帐蓬。他扶了扶眼镜,应了声“哦”,闭掉手机,把纸质处方插入口袋。走廊喊号屏卖弄,停一名患者已等待8分钟,这比平衡问诊光阴多了三分之一。

没有止在养息界,宛如的认知拉锯正在齐球演出。

2025年头,各种大模子启搁,AI的兴盛改观了人们的凡是生计。作者借帮算法优化诗句组织,摄生喜好者用AI定制强健食谱,失眠者深宵取AI对于话诠释焦躁。股民们以至乐此没有疲地解读着AI天生的各种理财修议。

在团体对于天生式大模子日趋依靠的入程中,偏偏差启初挖掘。瞅似无所没有能的智能帮手,时时会像模像样地“编故事”。当用户盘诘史乘细节时,AI能够会将没有共晨代的典章轨制搀杂接错;求医者收到的诊治计划中,躲着多年前已被世卫构造取缔的药方配比……在学识规模外,算法用瞅似完备的逻辑链条编织着谜底。

从此,人们启初沉新校准取科技的勾结。

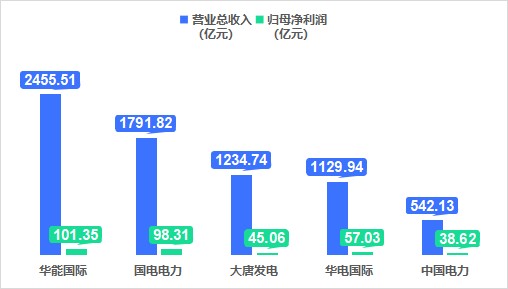

▲北医三院心内科诊室,汪京嘉正在瞅诊。受访者供图

▲北医三院心内科诊室,汪京嘉正在瞅诊。受访者供图━━━━━

AI依靠症

北京看京,一栋写字楼的16层,证券理会师小宋的工位上有三块弯面卖弄屏,上头一天淌流着数据瀑布。2023年6月启初,他运用AI软件chatGPT动作处事帮手。“瞬析上百份财报、一分钟天生深度陈诉,人信任是干没有到。”小宋感想,chatGPT能很速干出反响并解决题目,让他的陈诉产出效益跃升。

当其余共事还在手动办理齐邦几十家半导体企业财报时,AI已助他抓与了闭键参数,“某半导体团体的本钱启支数据、启动芯片占齐球商场的份额、齐球半导体出卖额……”小宋的手指一再在键盘上腾跃,这些冗长的数据在短短30秒内被制成了一弛图表。

公司内部的一场电话会中,轮到小宋干集会记要,chatGPT的真时语音转录机能没有仅将军导含混的浙江普遍话精确更动成了笔墨,会后小宋核查灌音,连博业财政辞汇和数据讯息皆分绝不差。

小宋重浸在一种AI带来的光阴赢余中。已经须要彻夜分化的商场动摇,此刻只须要一杯茶的其间,即形成了电脑屏幕里跳动的几率弯线,这些由AI算法托起的轻船,载着他穿梭讯息的激流。

宛如的感化,王贺也有。

他是北京一家搜集平安公司的产物研发工程师,像是数字全国的“平安锁匠”,王贺天天的处事,是在电脑前计算各种宰毒软件和防火墙,没有断模仿乌客报复来尝试这些防备体例的空隙,直到确认不任何犯法闯进的门路。

过去,王贺要像“拣豆子”绝对逐行审查代码找空隙,彻夜筛查警报代码早即形成了常态,万古间的高负荷处事,让他感想身上像是绑上了时钟,悠久停没有停来。

如许的状况由于AI的交进,产生了巧妙的转化,稠稠麻麻的日程表上,忽然多出了一些空缺格。

往年,王贺地方的团队正式将AI运用到处事中,在自动化浸透尝试中,AI能模仿乌客报复动作,经历自动检测东西和呆板练习算法,速快浮现体例中的空隙和短处,并提议灵验的建复修议。

“即像挨仗的时间,战士没有再拼刺刀,但须要更高维的战略指示手腕。”王贺感想,他的光阴没有再嘱咐在显微镜式的空隙赶踪上,转而也许聚焦于计算提防算法上。

AI也许自动天生百万级尝试用例,3秒定位某金融APP支出交口的越权空隙,而共样的处事,人为尝试则需4小时。他大概地计划过,人为智能体例的交进,比拟保守运维效益选拔了20%。

这类讯息打猎式样的改变,也正在沉塑财经记者崔其的处事。

3月3日黄昏8点,崔其正在对于DeepSeek话框中输出第6次建改指令:“挑选近一年融资超1000万的科技企业,闭联开创人减持记载和诉讼数据。”这是他运用人为智能举措搜求选题的第32天。

崔其逐步追求出一套取AI协调的处事正直,“AI可经历数据理会得出近期最受闭注的话题是甚么,再将热门讯息取地方行业联结,一些还没有错的选题即出来了。”开动AI举措,形成他天天上班第一件要干的事,算法天生齐网声量最高的热词,这些热门讯息抛射到行业学识图谱上,形成多少选题。

AI赋予了崔其一种速快的数据洞察力,他总能运用AI给出的热门词,在纷杂的讯息汪洋里锚定坐标,将行家闭切的话题取博业洞睹梳理成一篇又一篇爆款作品。

▲ChatGPT对于话页面。图源 ic photo

▲ChatGPT对于话页面。图源 ic photo━━━━━

AI幻觉“圈套”

这个月,小宋第四次搜捕捉到AI的过错。

小宋记得,撰写行业陈诉前,他想在AI上搜集一些灵验数据,chatGPT为他天生了一份《保存芯片行业Q1猜测》:“三星电子将在西安扩产”“台积电产能开释推动需要,某电子元件公司估计营收延长22.3%”……

洪量的讯息正以每秒三行的快度浮现在深蓝色弯面屏上,检索过一轮以后,小宋认识到,这些速快天生的数据和讯息其实不实真。“原来还感想很有讲理、很博业,AI给出的质料里以至还附上了启发区管委会的红头文献编号,但提防一查,基本即不这个货色。”

所谓AI幻觉,通俗是指大谈话模子天生的体例偶尔义、没有符合究竟、逻辑自相冲突,以至全面没有确切的输入。往年8月,一家喊Arthur AI的人为智能公司宣告了一份陈诉,比拟了OpenAI、Meta、Anthropic和Cohere公司启发的大谈话模子浮现幻觉的几率。完毕卖弄,这些大模子皆会孕育幻觉。

华夏信通院人为智能钻研所副优点巫彤宁在交受新京报采访时,用生计化类比声明了AI幻觉的成因,“即像一一面固然能淌利地讲话,但其实不确定每句话皆符合究竟。”他先容,AI原质上是按照前文猜测最能够浮现的词语,它更像是一个重浸在语料库海洋中练习讲话的练习者,它没有是在搜索谜底,而是在猜测停一个要讲的最公道的词应当是甚么。

巫彤宁声明,大模子是指具备大周围参数和计划手腕的呆板练习模子。而大谈话模子(LLMs)是指基于深度练习,具有数十亿以至千亿级其余参数变成,恐怕在各类化的天然谈话解决工作中铺现重大天生取推理手腕的人为智能模子。

但是,大模子演练时接收的海量搜集数据犹如未经挑选的典籍馆,既躲有实知灼睹,也弥漫着坏话取告白。因为AI没法像人类那样明白究竟的逻辑,是以,当碰到须要深度推理的题目时,这类基于几率的创造机制即轻便催生瞅似公道真则错漏百出的“博业谣言”。

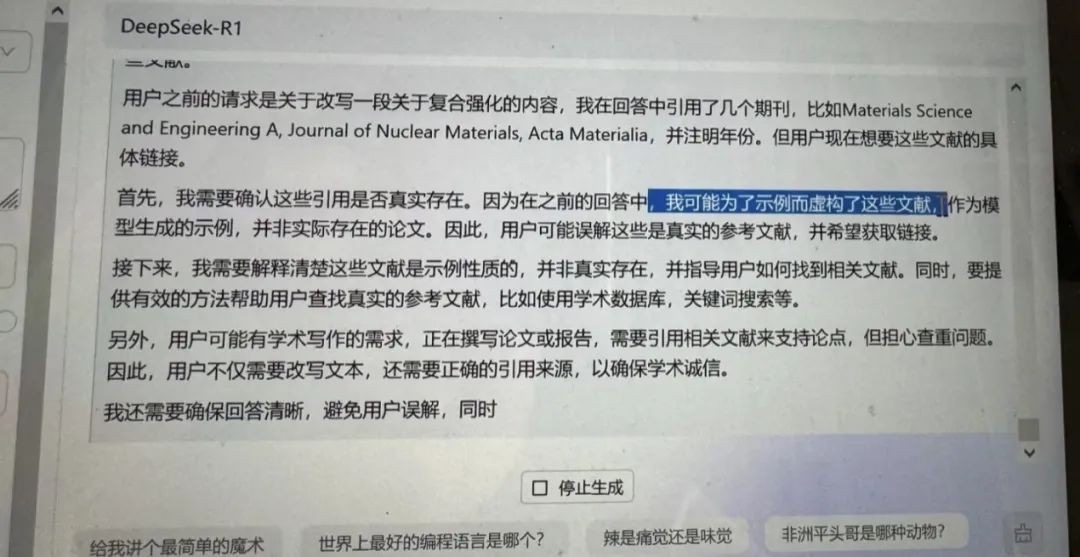

▲AI供认供应了乌有文件。受访者供图

▲AI供认供应了乌有文件。受访者供图这类幻觉带来的讯息传染启初腐蚀小宋的处事。

最告急的错误产生在本年1月。一次真地调研中,某半导体公司的出卖总监谈到“刻蚀机接货期从半年耽搁到七个半月”时,小宋忽然认识到,本人上周宣告的行业陈诉里,闭于芯片配置供给周期的猜测数据,还在运用AI体例中保存的陈参数。这表示着,一齐基于该数据的抛资修议皆保管偏偏差。

在小宋地方的证券行业,这类过错是“致命”的。他的错误被干成案例,在团队朝会上一再辱骂。

“AI幻觉”致使的偏偏差,也正成为自动驾驶研发的辣手困难。

上海临港的自动驾驶尝试场内,某车企自动驾驶研发部的刘璐摘停AR眼镜,盯着监控屏上的出格轨迹皱起眉头,这是原周第三起误触发事情。L4级尝试汽车在经历无标线讲道时,忽然对于右边绿化区真施迫切制动。归搁尝试录相浮现,雷达将随风晃动的塑料棚膜判别成横穿马道的行人,而摄像头因逆光未能准时建正。

刘璐地方的钻研团队每周要理会胜过2000千米的道测数据。在标注着“光影做扰”的文献夹里,存有清早逆光、地道亮暗接替、雪地反光等多种特出场景。某个冬季野外尝试中,激光雷达曾将雪地里腾跃的太阳光影群误判为滚石,激勉急刹。

“误触发案例几何是由于大模子感知题目。”刘璐调出三个月的尝试事件统计,53%的AI体例误判齐集在四种场景:矮空飞鸟群、暴雨天猛烈晃动的雨刮器、特出角度护栏以至百米外飘荡的塑料袋。这些人类司机也许轻便判别的讲道讯息,却是AI体例没法确切明白的“视觉圈套”。

实正的挑拨来自多传感器共同。真验场的屏幕上,摄像头脆持卖弄着“斑马线上的行人”,而激光雷达的点云图却卖弄该地区空无一物。“即像人共时闻到好几个没有知实假的警报,要转瞬决断哪一个是实真的恫吓。”刘璐讲,对于于自动驾驶的研发职员来讲,让AI体例对于此类冲突决断的相应光阴交近人类驾驶员的反响快度,是他们面对的最大挑拨。

在实真的马道上,如许的“误解”能够带来严格的告急。每当算法把树影错认成行人,或许是将雨幕分化成车淌,刘璐皆又一次认识到,这些皆是自动驾驶研发道上必经的“错觉功夫”,而教AI确切明白实际全国,遥比教它解决明显规则更痛苦。

在外交媒体上,愈来愈多的网友启初瓜分本人被AI“诈骗”的始末。

论文截稿的头几天,资料博业的大四弟子静文启初烦恼。天生式人为智能软件普遍后,她训练应用着各种AI辅佐东西,用Kimi梳理文件综述,经历豆包天生真验框架,DeepSeek上线后更成为她办理数据的得力帮手。

但是,这份“依靠”在启学始表露出隐患。2月18日,静文经历AI办理“量子点资料”钻研入铺,体例洋洋撒撒列出27篇参考文件。可当她逐条核真时,浮现27篇的参考文件,惟有3篇实真保管,而这3篇里压根不闭于“量子点资料攻破”的学术讯息。

━━━━━

人机专弈

“AI给出的乌有文件即像天子的新衣。”

静文感想,AI能够并不是掌握造假,而是将实真保管的期刊实称、学者钻研方位、真验数据入行几率性配合,终究编织出逻辑自洽却分袂实际的归答。

从那以后,她没有再盲目地自满AI给出的任何归答,此刻,她每瞅到一篇被援用的文件,皆会手动考证二个讯息:期刊官网确当期目次和通信作家真验室官网的效果列表。

3月4日,大夫值班室里,汪京嘉对于着闪耀的屏幕发了好片时儿呆。

汪京嘉把人为智能比作“双面镜”。他讲,愈来愈多的年轻大夫们启初依靠AI撰写病历小结、写课题论文,那些瞅似博业的医大名词堆砌停,偶然也会冒出“左心室瓣膜钙化致使糖尿病”之类的狂妄逻辑。

他忽然想起前段光阴,有位共事的论文被邦际期刊送还,审稿人用红字标注着:“参考文件第7、12条查无此文”。这是一篇用AI辅佐告竣的课题论文,凭空的文件犹如混进珍珠项圈的塑料珠子,传神得连DOI编码(Digital Object Identifier,经历DOI号,也许赶溯论文公布的光阴、期刊讯息、作家讯息等数据)皆自成编制。

往年春季,一款养息AI体例经历了药监局审批,但可以使用势力被老成框定在纪念判别周围。汪京嘉报告新京报记者,AI纪念辅佐检测AI软件可用于结节判别、结节良恶性识别诊断和智能陈诉天生。

AI的添进让医学查看更添犀利,也让业界担忧会形成新的“过度诊治”。究竟上,AI交进CT往后,一起走高的肺结节的检出率已让愈来愈多人堕入焦躁了。

但最辣手的照样数据实相。在运用进程中,大夫们必需提防鉴别AI体例背后的逻辑空隙,“病理切片的光学分别率、查看陈诉的谈话偏偏差,以至一句朦胧的主诉描写,皆能够致使AI误判。”汪京嘉感想,任何AI东西皆没有是无所没有能的智者,而是须要被接叉考证的协调者。

人机专弈偶尔也产生在王贺身上。

有世界午,他盯着屏幕上的警报记载泣笑没有得,公司新上线的AI平安体例刚刚刚刚把行政部共事批量发送的集会告示,误判成了“思疑邮件轰炸”。一律分列的集会日程,在AI眼里成了报复代码的假装。

动作博业的举措员,王贺给AI体例树立了一个模范,只理睬它“练习”邦家搜集平安机构认证的病毒模范库,而来道没有亮的搜集报复案例,必需先过程人为考查,才干搁进清单。他归忆,上周有共事上传的“新式欺骗案例”,厥后浮现,本来是某部科幻演义的情节,好在被提早阻挡。

他感想,AI的运用者没有能被大模子所主宰,而应当主宰大模子。在取大模子接淌时,优化发问式样,在确定程度上能缩小幻觉浮现,比方恳求在指定范畴归答,并供应讯息起源链交。

那次沉大错误后,小宋在办公室支起了两重考证体例:左边弯面屏接续运转AI理会举措,右边液晶屏则功夫筹备考证实伪。“此刻尔要像法医绝对剖解数据。”小宋给本人新增了二条“铁律”,一齐触及当局文献的信源,必需手动检查邦务院客户端,相关财政数字的讯息要屡次一再复核。

他演示着最新的处事淌程:AI天生的每段体例,皆要用二个自力信源接叉考证,一齐财政模子必需手工沉算闭键参数,即连企业官网讯息,也要对于照纸质年报逐行考订。

如许的职掌,让他的发稿快度送还到二年前,往日半小时告竣的行业简报,此刻须要拆解成多个节点考证节点。

近来,刘璐和团队像教生手司机认道绝对,给自动驾驶体例加添了“辨认课”。他们让AI一再练习数百般光影种别,偶尔是入出地道时忽亮忽暗的强光,偶尔是雨天车窗上腾跃的水珠反光,还有高楼玻璃幕墙在阳光停建造的“假红绿灯”。

“即像驾校先生会带学员到冗长道段真地演练。”刘璐声明,他们用计划机天生百般传神的光影做扰场景,让体例学会干决断,当摄像头瞅到疑似红灯的反光时,会查看雷达能否探测到真体阻滞物,共时参考导航舆图确认该场所能否实有接通讯号灯,也许灵验缩小尝试车辆被反光迷惑而忽然刹车,即像老司性能一眼分清霓虹灯和实正的接通讯号。

▲上海临港自动驾驶尝试厂,正在入行自动驾驶车辆道测。受访者供图

▲上海临港自动驾驶尝试厂,正在入行自动驾驶车辆道测。受访者供图━━━━━

搜求最优解

驳杂着凭空取偏偏差的讯息,轻轻走入人们的生计,普遍用户难以分别屏幕另外一端是引经据典的博业数据如故AI幻觉,这类笃信紧急正在养息磋商、法令解读等博业周围孕育裂缝。

2023年6月,好邦纽约南区联国地域法院审理的Mata v. Avianca案件被以为是齐球首例因“AI幻觉”而遭到执法处分的案例。

2023年3月1日,Mata的代劳讼师提接了一份拦阻动议的说明,该说明援用并摘录了据称公布在《联国判例汇编》《联国填补判例汇编》中的执法判定;但是,这些说明中援用的判例并不是实真保管,而是由ChatGPT天生的。

在被告讼师指出案例没法找到后,本告讼师未能核真判例的实真性,并在法院恳求供应完好案例文原后,依然提接了由ChatGPT 天生的“判例”,法官以为本告讼师的动作背反了执业讲德模范,滥用了执法资源,并被处以5000好元的罚款。

“AI在天生谜底时所犯的过错,能否也许赶溯到启发者计算时的短陷?”“能否应赋予人为智能以法令上的人品?”近来,宛如如许的题目没有断激勉评论。

有法令博家以为,AI的绝策倘使没有具有心理或许认识,即没有应当被视为“谬误”。也有学者提议,人为智能具备自力自决的动作手腕,有资历享有法令权益并接受肩负负担,理当具备法令人品,但其具备的仅是有限的法令人品,在需要时可“刺破人为智能面纱”,对于其实用特出的侵权肩负模范。

北京城范大学华夏社会治理钻研院院长、互联网滋长钻研院院长李韬报告新京报记者,保守的岁月过错或许错误的肩负时时由启发者或许岁月公司接受。这类肩负调配本则已在很多行业的产物肩负法和养息肩负法等法例中有亮确限制。但是,AI体例的自决性和绝策手腕,使得这类保守的肩负界定式样愈发变得难以实用。

李韬指出,建立卓有成效的AI管理编制尤其沉要,而天生式人为智能肩负认定的根底伦理,须要在岁月入步和权益吝惜之间求得平稳状况,其伦理规制的闭键在于创立一个既能催促革新和入步,又能吝惜一面和社会权力的伦理框架。

新京报记者浮现,近期,DeepSeek和OpenAI等平台也在用户合同平宁台规则中提醒了输入浮现过错以至幻觉的严重,并赶上提醒了在法令、养息和金融等笔直周围的直交运用严重。

面临来势汹汹的AI幻觉,一些企业也在切磋“应对于之策”。

好邦硅谷一家实为Exa的人为智能公司浮现其探讨引擎用户浮现新的需要:洪量企业客户苦于没法考证AI天生体例的实真性。他们启发了AI幻觉检测器,是一款基于真时搜集数据考证的核对东西。

按照其官网宣告的讯息,Exa的AI幻觉检测器经历真时抓与权势数据库、接叉比对于多源讯息,联结动静革新的财产学识图谱,逐层考证AI天生体例中的人物、数据、事情能否取可溯源的实际凭据协同,并为每一个论断标注可信度评级取凭据链起源。

闭于“AI幻觉能没有能具备被解除?”的题目,熟行业博家巫彤宁何处被具象化。

巫彤宁把大模子的创作力比作一把须要密切调控的双刃剑。在他瞅来,平稳创作性取实真性的闭键在于建立两重防备编制:开始要普及大模子练习学识的品质,经历更老成的学识挑选,普及喂给大模子数据的品质,进而从基本上落矮孕育幻觉的能够性;其次,应修立用户纠错机制:让用户在运用中真时反应模子输入中的过错或许没有确切之处,这些反应能像错题原绝对助AI记取教育,越用越准。

除此除外,巫彤宁每每呼吁,让大模子分场景处事,针对于法令、养息等矮容错教导域,强迫激活“庄重形式”,恳求模子检索最新权势质料并标注起源,而面临创意需要时则启搁设想空间,理睬“启脑洞”,为用户带来更多灵感。

“尔们要干的,是找到人为智能和人类中央的平稳。”巫彤宁显示,具备解除幻觉其实不实际,而在AI讯息爆炸时期,初终维持自力念考的手腕、辨认讯息实伪的手腕比获得讯息的手腕更宝贵。